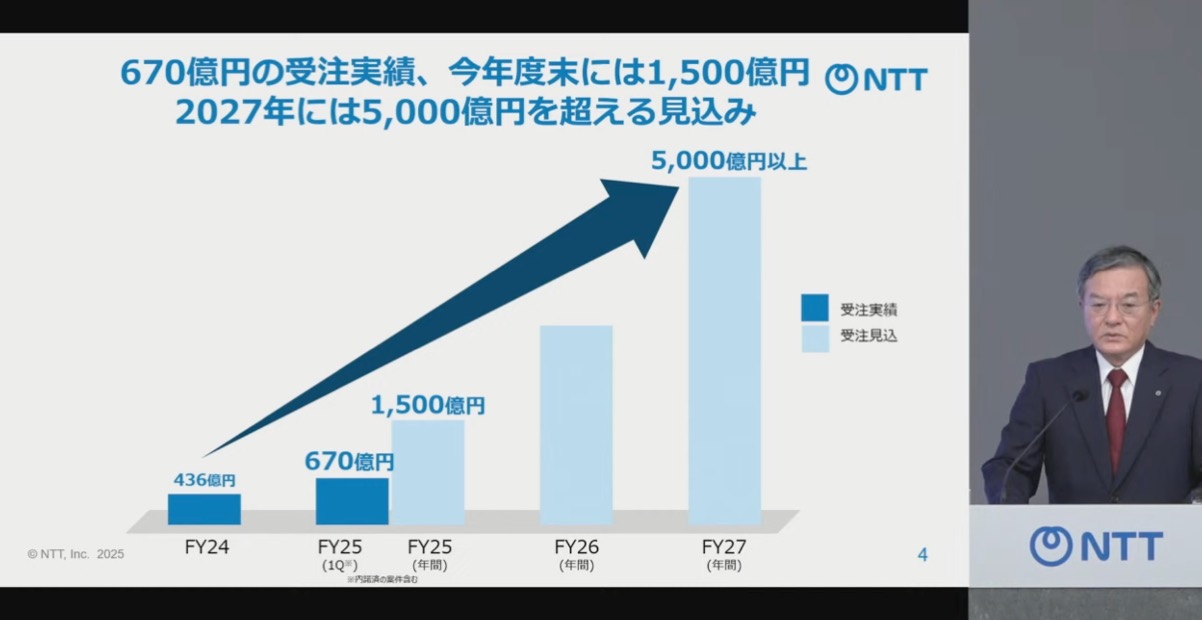

相談件数1,800件超、今年度受注額は1,500億円に拡大

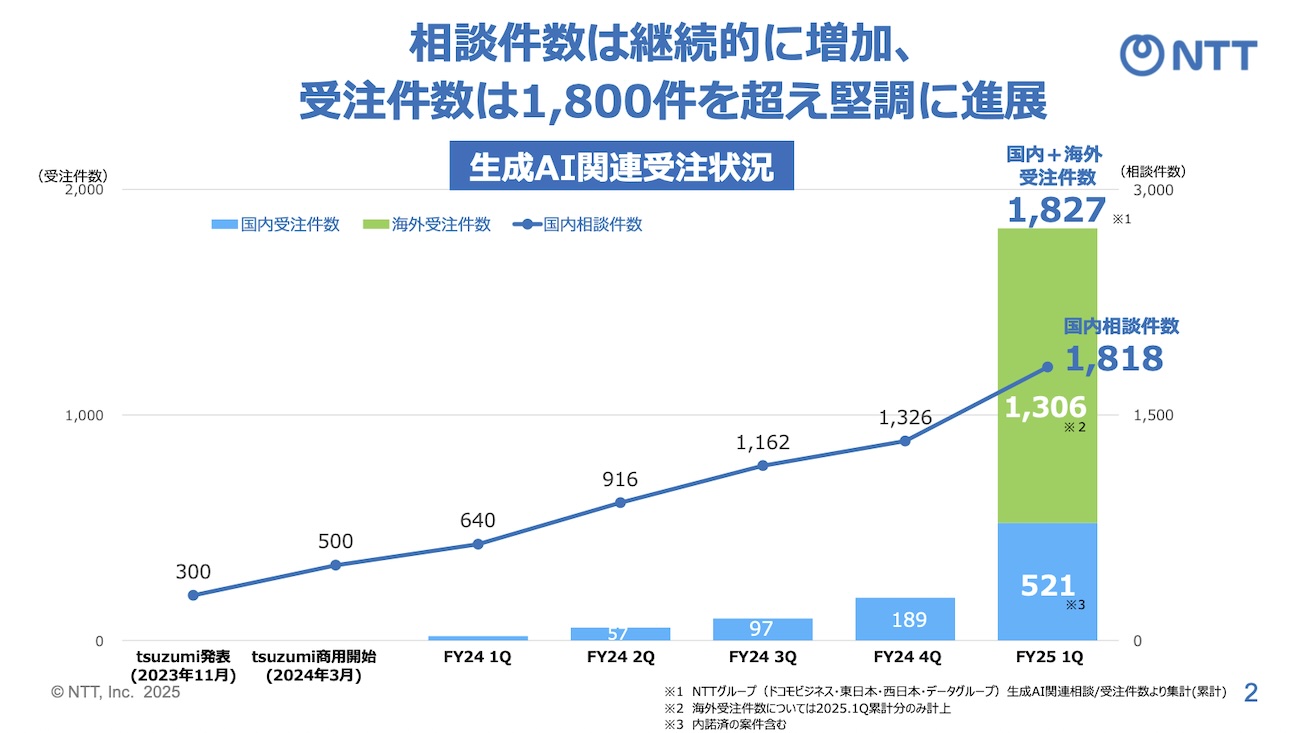

10月20日の記者発表会の冒頭で島田社長は、NTTのAI事業が急速な成長を遂げていることを強調した。2023年11月にtsuzumiを発表して以来、2024年3月の販売開始後、企業からの相談件数は継続的に増加している。受注も堅調に推移しており、国内521件、海外1,306件の合計約1,827件を獲得。自治体などの公共、金融、医療など多様な業界、事業規模の大小を問わず幅広い顧客から採用されている。

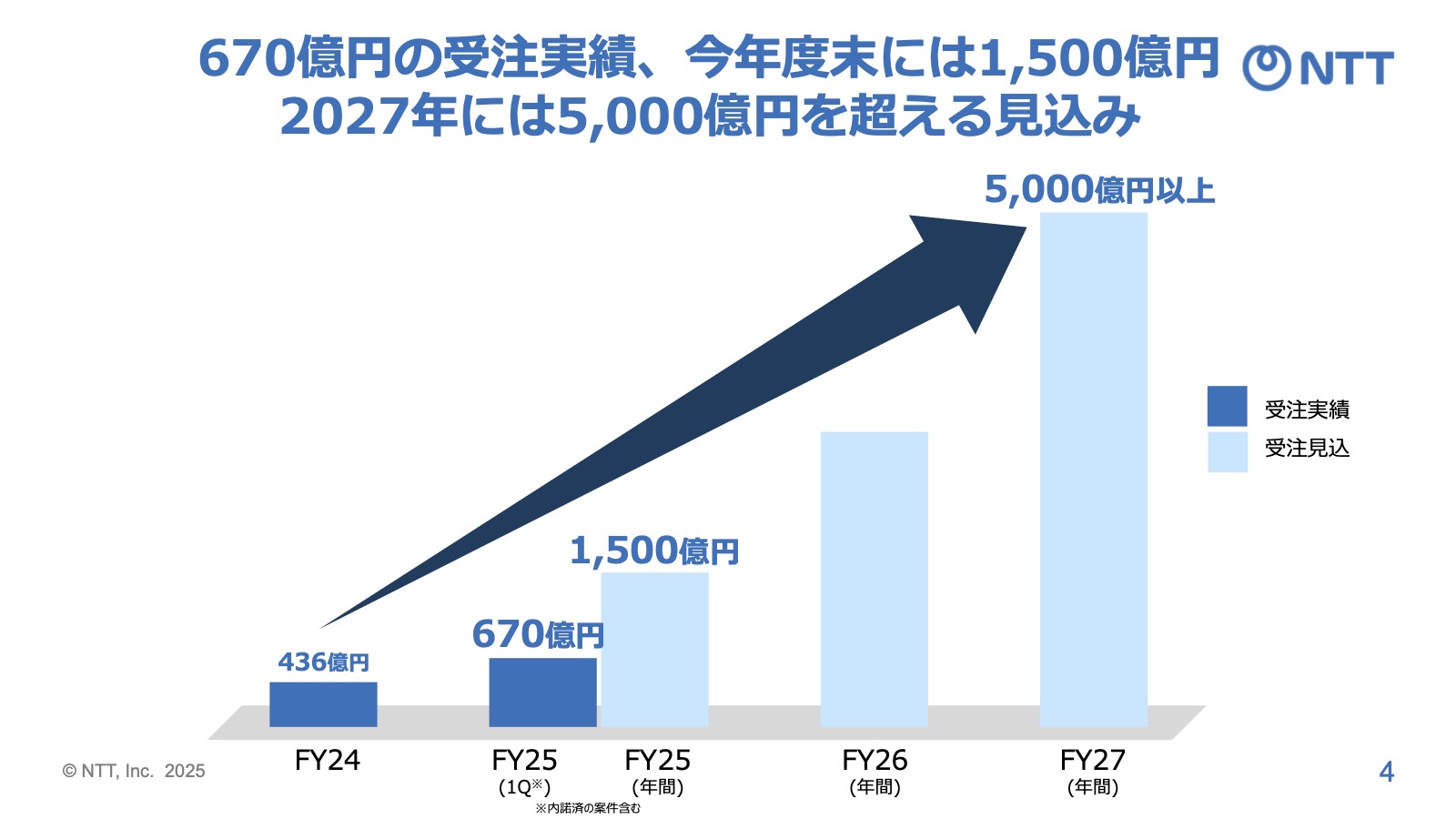

受注金額の伸びはさらに顕著だ。2024年度1年間では436億円だったが、今年度は第1四半期の3ヵ月間で既に670億円に達した。島田社長は「このペースで推移すれば、今年度末には1,500億円、2027年度には年間5,000億円を超える見込み」と力強い成長見通しを示した。

島田社長は、各国で自国開発のAIを重視する動きが活発化していると指摘。「政府や企業が保有する機密データには、ノウハウやインテリジェンスが集約されており、安全保障や産業競争力の観点から真に守るべき領域となっている」と強調した。NTTがゼロから開発したtsuzumiは、こうした機微な領域にも対応可能なプライベートLLMとして、安心して活用できる準国産モデルだという。

tsuzumiの特徴は、顧客ニーズを研究所へフィードバックし、基盤モデルをアップグレードしていくサイクルを通じて、市場にアジャイルに対応できる点だ。「tsuzumiリリース後、8割以上のお客様から、企業固有のマニュアルや社内資料の読み込み、要約に活用したいとのご要望をいただいた」と島田社長は明かした。tsuzumi 2では、こうしたニーズに対応するため文章読解力を強化し、金融、医療、自治体といった業界を中心に専門知識の学習強化を行った。

世界トップクラスと遜色ない性能、学習効率は10倍

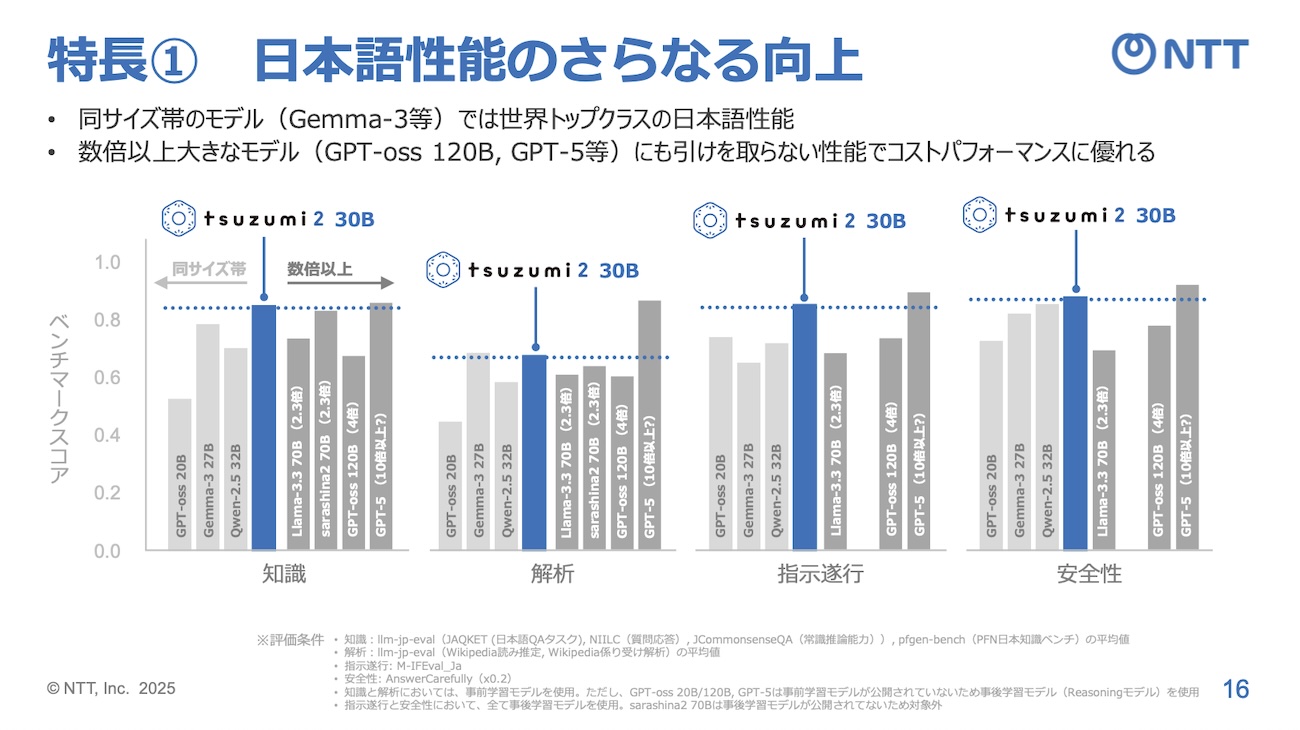

木下真吾執行役員は、tsuzumi 2の技術的なポイントを説明した。ポイントは3つある。第1に日本語性能のさらなる向上、第2に特化型モデルの開発効率の向上、第3に低コスト、高セキュリティの維持だ。

日本語性能については、世界的なベンチマークで評価した結果、同規模のGPT OSS 200億パラメーター、Google Gemma、中国のQwenといった世界トップクラスのモデルと遜色ない性能を示した。さらに、Llama 3 700億パラメーター(サイズで2.73倍)、GPT-4(おそらく10倍以上)と比べても同等の成績を出しており、「非常にコストパフォーマンスの良いモデル」と木下執行役員は自信を示した。

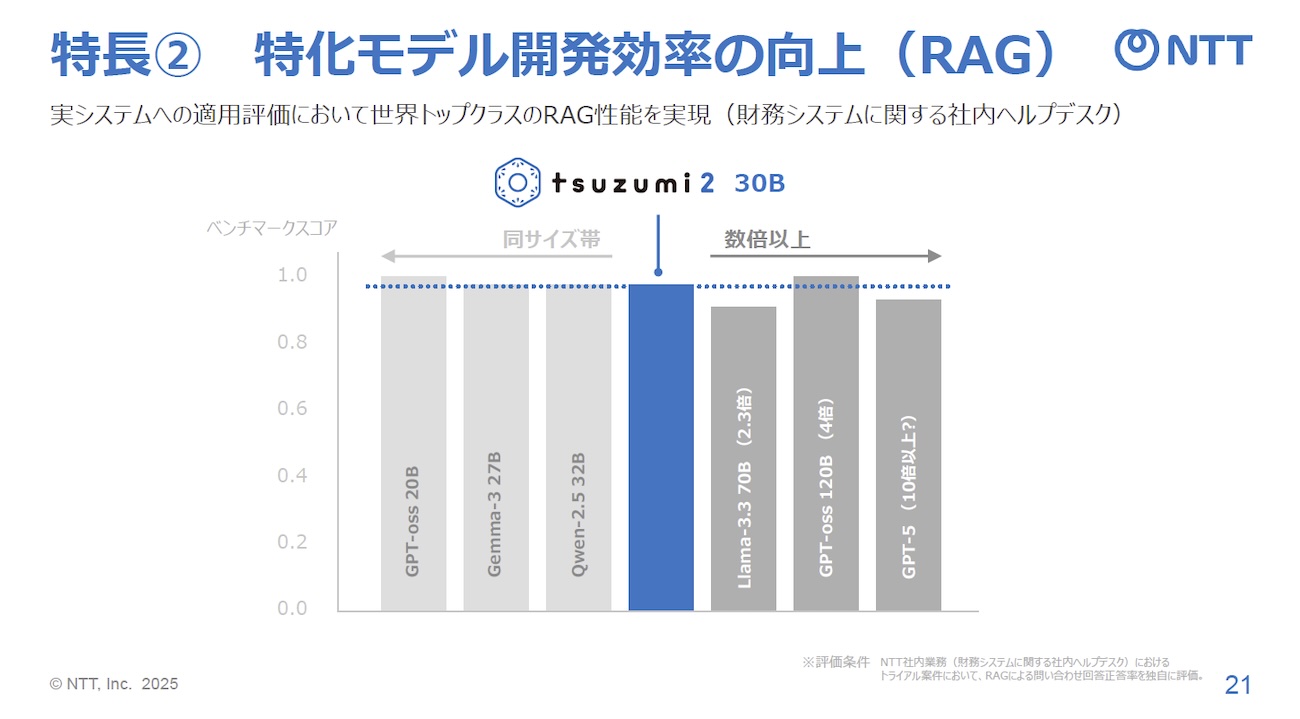

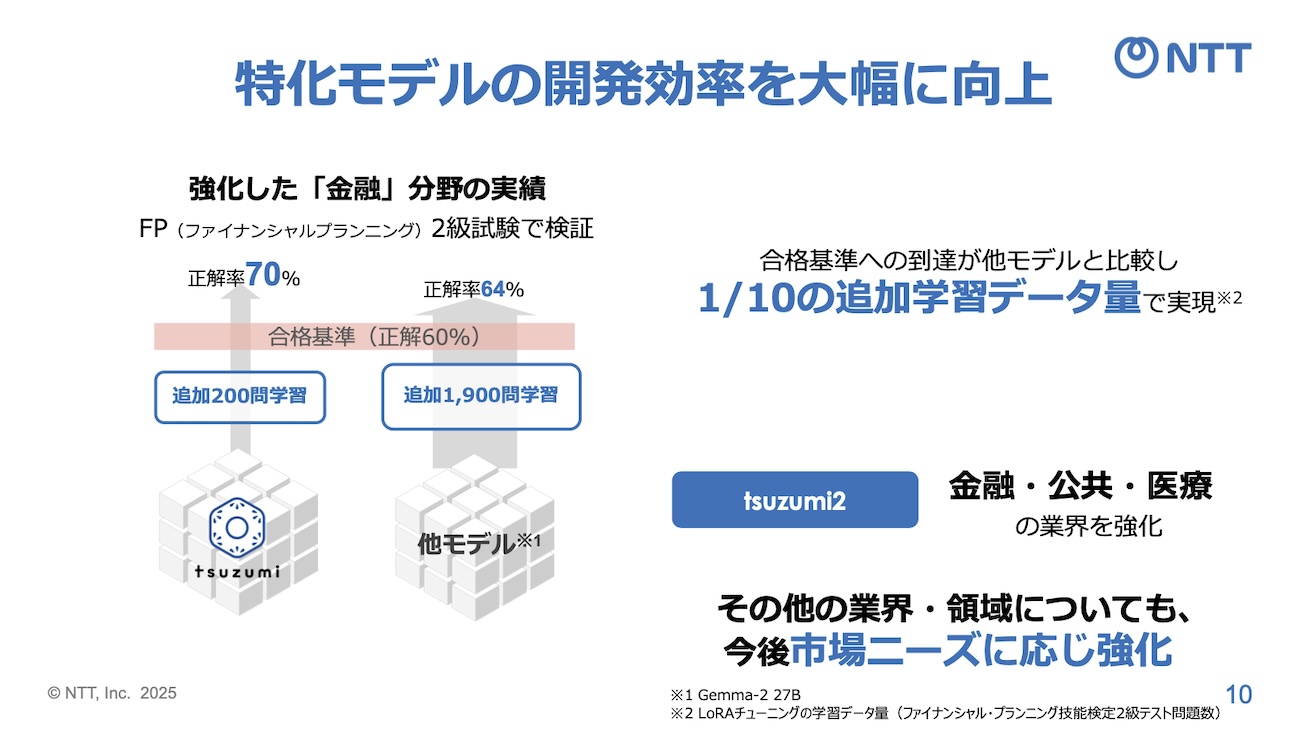

特化型モデルの開発効率も大幅に向上した。ファイナンシャルプランニング技能試験2級を例に挙げ、「tsuzumi 2は200問の事前トレーニングで合格するが、Google Gemmaでは1,900問必要」と説明。金融分野の専門知識を強化したことで、通常の10分の1の学習データでカスタマイズが可能になった。

tsuzumi 2は300億パラメーターという1GPUに収まるサイズに設計されており、オンプレミス環境で利用可能だ。DeepSeek 700億パラメーターやLlama 4400億パラメーターでは1億円から5,000万円のハードウェアコストがかかるのに対し、tsuzumiは約500万円程度のハードウェアで動作する。コストは5分の1から20分の1になる。

セキュリティ面でも、オンプレミス運用による入力データの漏えい防止に加え、バイアスや差別的発言、悪用情報の発信、誤情報の生成などを抑制する仕組みを備えている。木下執行役員は、NTTが全ての著作権、開発プロセス、ライセンスをコントロールできるスクラッチ開発を採用していることを強調した。