(筆者注)各話者のコメントは、ポイントとなる発言を抽出したものとなる。本稿は各氏のコメントを極力忠実にお伝えするものであるが、内容については全話者の確認は得ておらず筆者の文責となる。

AIが切り開いた「拡張された熟議」を活かせない日本

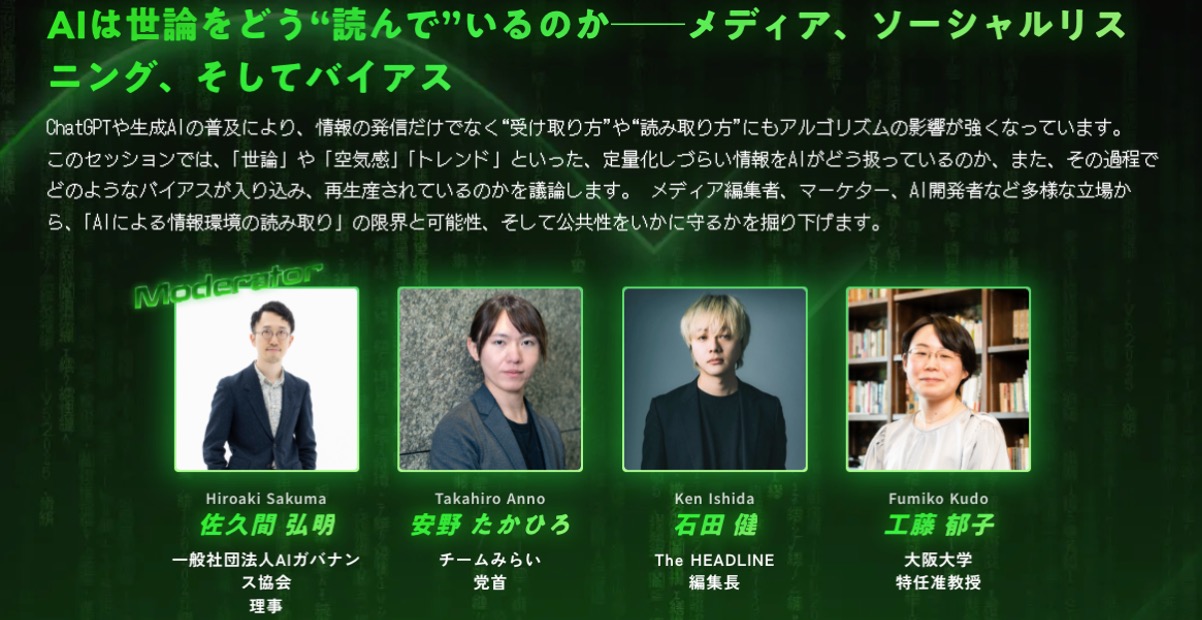

AIによる世論分析自体は新しい話ではない。石田氏は、SNSを使った世論の読み解きは10年以上前に東浩紀氏が『一般意志2.0』で論じた世界観の延長線上にあると指摘する。では、何が変わったのか。それはLLM(大規模言語モデル)の登場による「ファシリテーションコストの劇的な低下」である。

安野氏は、ブロードリスニングの進化を二段階で説明した。第一段階は、大量のテキストを意味を汲んだ形で集約できるようになったこと。第二段階は、AIが「なぜそう思うのか」と掘り下げ、動的にインタビューする能力を獲得したことだ。これにより、従来は同じ会議室に集まる必要があった熟議が、時間と場所を超えて「拡張」される。

安野氏:AIが人間と人間のコミュニケーションの中に入ることで、熟議を拡張できます。台湾などでは10年前から掲示板上で熟議をしようとしてきましたが、ファシリテーターがめちゃくちゃ大変でした。人間のファシリテーターが時間とコストを払って、怒り出す人をなだめたり質問したり。ファシリテーターが不足し、バーンアウトして辞めていくことがこの10年起きてきました。AIがこのファシリテーション機能を担うことで、熟議のコストがめちゃくちゃ下がっています。

石田氏:7、8年前にPolisというツールが出てきて、いろんな意見への賛成・反対から意見ベクトルを作り、次元圧縮して二次元平面上で派閥を可視化できるようになりました。トップダウンで「これとこれの派閥がある」と決めてから分類するのではなく、大量の質問への回答データからボトムアップに派閥を浮かび上がらせることができます。

工藤氏は、この技術進化を歴史的文脈に位置づけた。1990年代、イタリアのベルルスコーニのようなメディア王が政界進出した際、莫大なコストをかけた電話世論調査が武器だった。それが現在、スタートアップ政党でも充実した分析ができるほどローコストになった。これは民主化であり「希望があるライトサイドの話」だという。

新興プレイヤーと既存のギャップ

しかし、石田氏が指摘したのは、この技術的可能性を活かすアクターの絶対数不足である。石田氏自身が立ち上げメンバーとして関わる政策推進機構は、政治資金収支報告書をOCRで読み取り、データベース化している。GPTやGeminiの登場で効率化が進んだが、問題は「こういうことをやっているプレイヤーが少ない」ことだという。

石田氏:政治資金収支報告書は手書きで書いたものを二重線で消して、もう一回手書きで書くという旧態依然の手法でやっています。これをOCRで読み解けるようになったのは大きな変化ですが、やはりプレイヤーが少ない。特に既存メディアは、選挙が公示されると批判を恐れて及び腰になり、新しい取り組みをやりましょうという話をしても動けません。既存メディアと新興メディアのギャップが大きく、しかも新興メディアが少ないところが、この問題をより難しくしています。

工藤氏は政府側のリスク対策最前線を報告した。フィルターバブルによる分断、アテンションエコノミーに基づく偽情報生成、ディープフェイクなど、AIがもたらすリスクへの対応として、今年5月に日本のAI推進法が成立。情報流通プラットフォーム対処法では、削除対応を原則7日以内、選挙期間中は2日以内と義務化した。

工藤氏:しかし、政治側のITリテラシー、AIリテラシーが低く、構えができていません。2017年のフランス大統領選挙では、マクロン陣営がサイバー攻撃を受け、流出した文書に誤情報が混ぜ込まれ、何が嘘なのか何が本当なのか分からないまま投開票日を迎えました。政治制度そのものへの信頼が揺らぐ現象が起きているのです。

「技術は価値中立的」という危険な誤解

議論はさらに深まった。石田氏が問題提起したのは、「テクノロジーが価値中立的だという風潮が強すぎる」という点である。

石田氏:安野さんにインタビューする側は、皆さんAIの話ばかり聞くじゃないですか。でも私は憲法九条どうですか、再分配した方がいいと思いますか、という話を聞きたい。価値中立的にテクノロジーから最適解が出てくるという前提に、みんなが引っ張られています。でもその前提には、この社会は成長した方がいいのか、再分配を強化すべきなのか、再分配するなら障害者か貧困層かジェンダーイシューか、という規範があります。人間の規範の理解がないまま、LLMが最適なものをアウトプットしてくれるという信仰は調整していきたいと思います。

安野氏もこれに同意し、「デジタルを使うのは当たり前として始めた新興政党の第1号だから、比較対象がない」と応じた。プレイヤーの数が少ないからこそ、技術至上主義に見えてしまうのだという。

モデレーターの佐久間氏は『システムエラー社会』(ロブ・ライヒ他著、NHK出版)を引きながら整理した。最適化指標が決まっていれば、AIで合理的な解を出せるかもしれない。しかし「何に最適化するのか」という配分は、必ず何らかの政治的ポジションを取らざるを得ない。そこを見ないといけないのだ。

安野氏:どんなAIも、ChatGPTだろうがDeepSeekだろうが、それ特有の偏りは絶対あります。AIだから偏りがないというのは完全に嘘です。一方で、人間がやっても偏りはあります。AIの優位性は、このモデルをこう使っていますという背後のロジックを完全に透明化できることです。どのモデルをどう使っているかをオープンにすることで、人間のブラックボックスに隠れているよりかは、事態は前進していると思います。