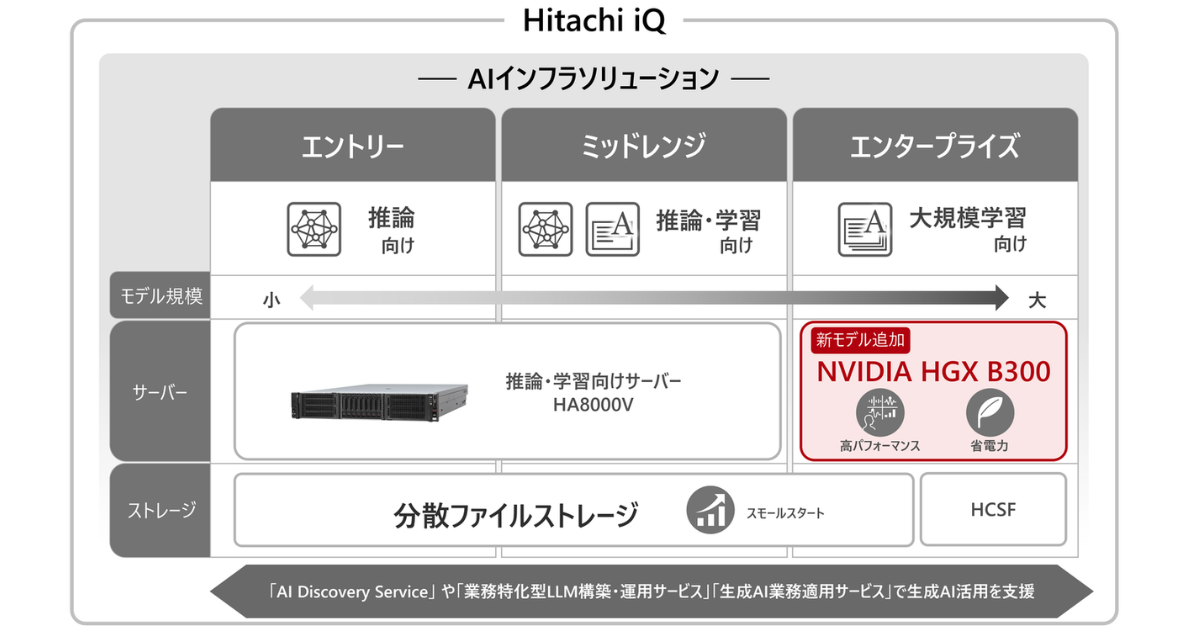

日立製作所(以下、日立)のグループ会社である日立ヴァンタラは、AIインフラソリューション「Hitachi iQ」のエンタープライズモデルに、最新のNVIDIA Blackwell Ultra世代を搭載した「NVIDIA HGX B300 サーバー」の液冷モデルを追加。日本国内で販売開始した。AIやデータのソブリン性の重要性の高まりに応えるオンプレミスソリューションとして、大規模AIモデルの処理性能を大幅に向上させ、企業が重要データを自社内で管理しつつ、AI開発や実用化を加速できる環境を提供するとしている。

Hitachi iQの新エンタープライズモデル

最新GPU搭載で大規模AIモデルの高速処理を実現

NVIDIA HGX B300は、最新のNVIDIA Blackwell Ultra世代のGPU搭載により、大規模言語モデル(LLM)など複雑なAIモデルの高速処理を支援する。また、GPUメモリーの容量はHGX B200の1.5倍となる最大2.1TBに強化。GPUクラスター間の通信を高速化する800Gb/sのネットワークは、複数のGPUがスムーズにデータ連携できる環境を構築し、AIモデルの処理速度と安定性を向上する。

高効率な液冷モデルで消費電力とラック占有率を大幅に削減

NVIDIA HGX B300の液冷モデルは、空冷モデルと比較して消費電力を最大40%削減し、運用コストも削減する。また、ラック占有率を最大60%削減することで、データセンターへの設置効率も向上。さらに、液冷による安定した冷却により、GPUの発熱を抑え、処理性能を長時間にわたり安定に維持する。これにより、高密度なAIシステム構築や電力効率の向上に寄与する設計となっているという。

高性能分散ファイルストレージでGPUサーバーの高速データ処理を支援

高性能分散ファイルストレージ「Hitachi Content Software for File powered by WEKA (HCSF) 」は、NVIDIA Cloud Partner (NCP)レベルにおいて「NVIDIA-Certified Storage」の認定を取得した。これにより、高い拡張性(最大10,000GPU)、堅牢なマルチテナント機能、および厳格なサービス品質(QoS)制御という要件を満たしていることが実証された。また、HCSFとNVIDIA AI Enterpriseの統合により、検証済みのブループリントと包括的なAIソフトウェアのライフサイクルサポートで、製品やサービスをより早く市場に投入できる能力を示した。

- 関連リンク

この記事は参考になりましたか?

- この記事の著者

-

AIdiver編集部(エーアイダイバーヘンシュウブ)

「AIdiver」(エーアイダイバー)は、株式会社翔泳社が運営する、企業およびビジネスパーソンのAIの利活用にフォーカスしたメディアです。経営、ビジネス、日々の業務をAIで変革したい「AIリーダー」の皆さまに役立つコンテンツを発信します。

※プロフィールは、執筆時点、または直近の記事の寄稿時点での内容です