最新AIでも“嘘”をつく「ハルシネーション」の技術的構造

EnterpriseZine編集部 竹村(以下、竹村):ビジネスの現場で生成AIを活用する際に最大の懸念点となるのが、AIが嘘をつくこと、いわゆるハルシネーションの問題です。この現象はなぜ起きるのか、技術的な構造を踏まえて教えてください。

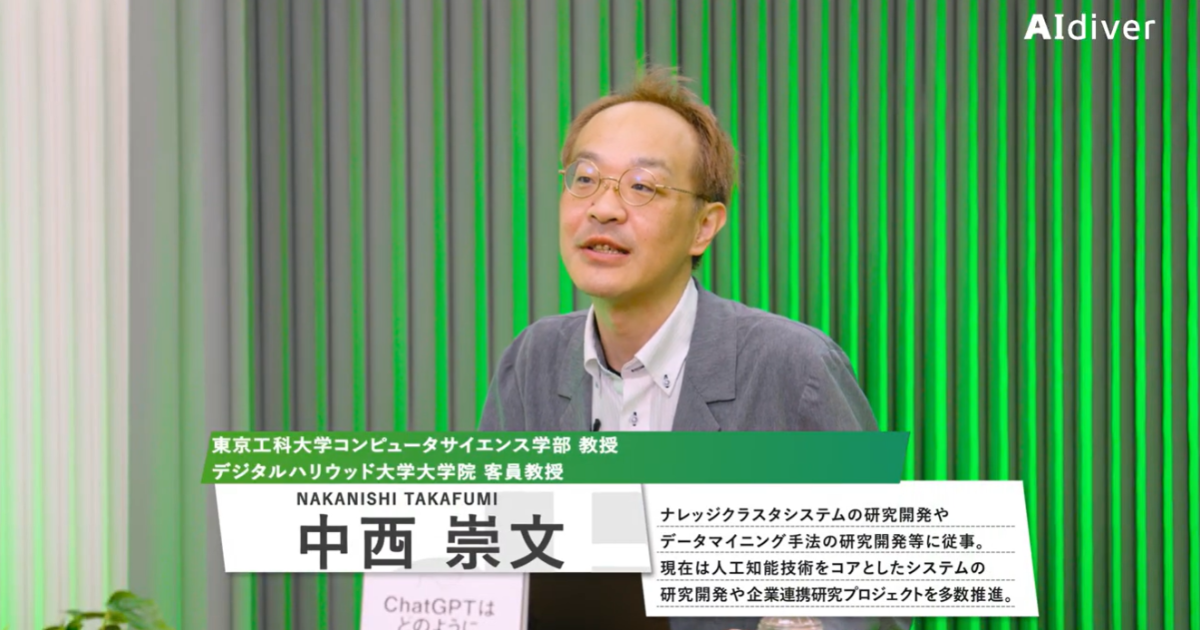

東京工科大学 中西崇文教授(以下、中西):まず理解していただきたいのは、ハルシネーションは現在主流の生成AI技術を外部検証なしに自由生成させる場合、原理的に100%防ぐことは難しいということです。これはバグやエラーではなく、AIの“計算の仕組みそのもの”に起因しています。多くのユーザーは、AIが百科事典のような膨大な知識ベースから、正しい回答を直接“検索”して引っ張り出しているイメージを持っていますが、実態は異なります。

AIが実際に行っていることは、「類似度」計算を含む大規模な数値計算です。入力文を単語、厳密にはトークンという単位に分解し、その文脈から次に続くトークンを確率的に予測しています。結果として、人間から見れば事実に反する内容であっても、AIの数理モデル上では「最も確からしい続きの言葉」として導き出されてしまうのです。

竹村:論理的な正誤ではなく、計算上の“近さ”で回答を選んでいるのですね。その近さをAIはどのように判断しているのでしょうか。

中西:AIは入力されたプロンプト(指示文)をそのまま文字として扱っているわけではなく、文章を細かく切り分けた単語や文字を「ベクトル」という多次元の数値の羅列に変換して処理しています。

たとえば、レストランを評価する際、「星4つ」という一つの数字だけでは、その店の特徴を十分に表現できませんよね。しかし、「味:4.5」「雰囲気:3.0」「価格:2.0」といった複数の数値をセットにすれば、その店がどのような個性をもち、他のどの店と似ているかなどといった特徴を数値的に判断できるようになります。

AIはこのように、一つの単語に対して数千・数万といった膨大な次元の数値を割り当てています。これによって、単語同士の「概念的な距離」を空間上の座標として捉えられるようになるのです。

ただ、AIはあくまで「過去のデータでは、この数値(単語)の次にはこの数値が並ぶ確率が高かった」という統計的パターンを再現しているだけです。インターネット上に存在するSNSでの雑談や科学論文、プログラムコードなどの膨大なデータがこの数値計算の材料になっています。そのため、AIにとっては「論理的に正しいか」よりも「データ的にそれっぽいか」が優先される。これがハルシネーションの正体です。

竹村:こうしたAIの仕組みを理解することで、利用者にはどのようなメリットがあるのでしょうか。

中西:AIが「確率で答えている」と知っていれば、出力された回答を無批判に信じ込むリスクを減らせます。たとえば、自動車が動かなくなったとき、エンジンの仕組みを少しでも知っていれば、「ガソリンがないのか」「バッテリーが上がったのか」といったアタリをつけられますよね。AIも同じで、仕組みを理解していると、ハルシネーションが起きやすいデータの少ない領域や抽象的な問いを避けたり、回答の精度を高めるための具体的なプロンプトを導き出したりすることが可能になります。