「LLM比較」の時代から「設計・構築能力」の競争へ

「1年前、お客様の質問は『AIで何ができるか』だった。今は『AIでどんな成果を出すか』に変わっている」。日本IBMの取締役副社長・村田将輝氏が2026年の年初の言葉は、業界全体の空気をよく映している。

一般に企業のAI動向については、LLMの性能競争やハイパースケーラーと呼ばれる大手各社のデータセンター・GPU等の半導体投資に関心が向きがちだ。しかし今、企業のAIへの取り組みはより複雑に、かつ戦略的なものとなっている。問われているのは、AIエージェントを業務プロセスに組み込み、ガバナンスを保ちながら安定運用するための「設計・構築能力」だ。

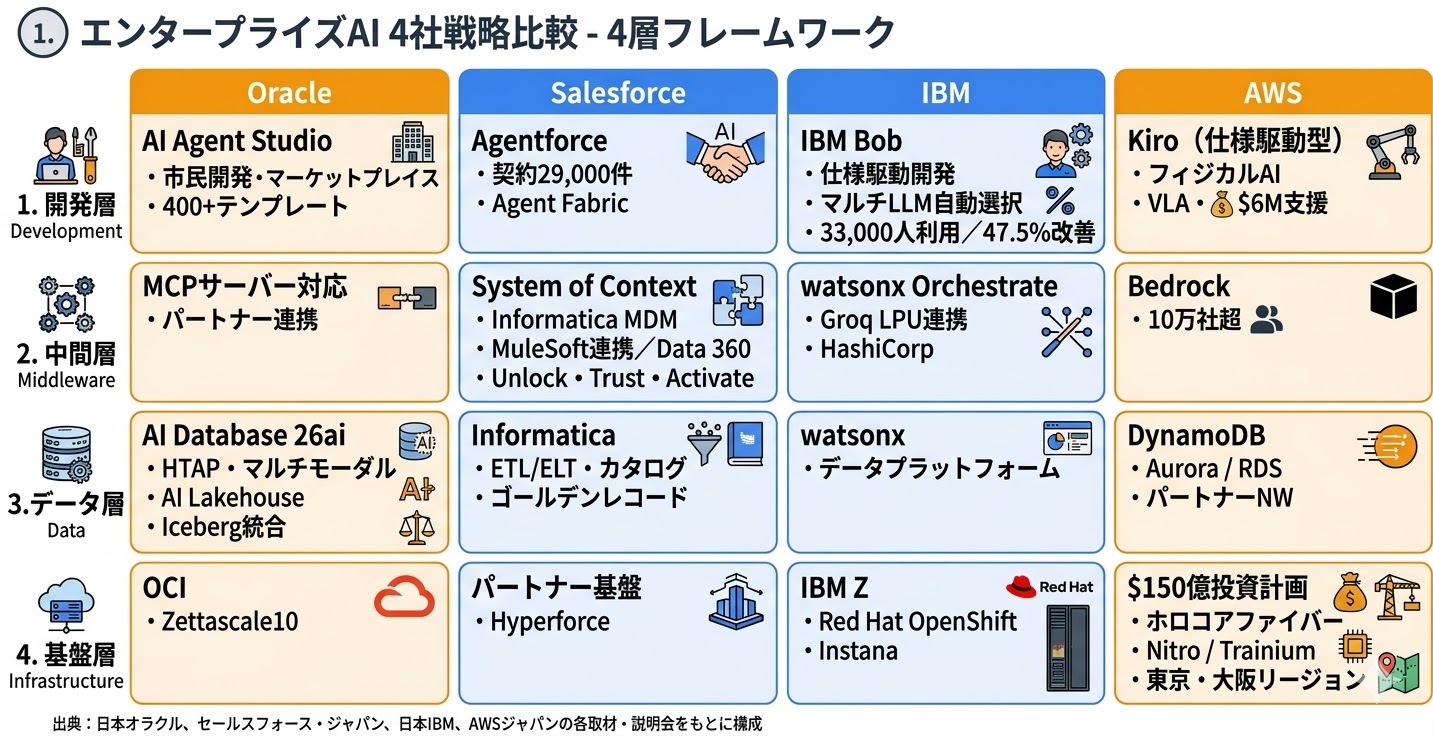

この記事では、エンタープライズAIの設計・構築能力を4つの層で捉えたい。基盤層はクラウドインフラ・ネットワーク・セキュリティ・専用チップなど計算資源の土台。データ層はERP・データベースへのデータ統合、マスターデータ管理(MDM)、データ品質の確保。中間層はAPI連携、コンテキスト化、データリネージュ(データの出所と流れを追跡する仕組み)、ガバナンス、AIエージェントのオーケストレーション(複数のAIエージェントを指揮・調整する仕組み)。開発層はAIエージェントの開発環境、仕様駆動開発、市民開発、エージェント駆動開発といった実装の入り口になる。

IBM──マルチクラウドに対応するオーケストレーターとして勝負する

10数年前、IBMは企業向けAIの代名詞だった。大文字の「Watson」はエンタープライズAIとして広く認知されていたが、生成AIの台頭とともに存在感を失った印象がある。

しかし現在、IBMは再びAIとクラウドの領域で攻勢に転じている。その戦略の核にあるのが、オンプレミス・クラウド・エッジを横断するハイブリッド環境への対応力だ。小文字になった「watsonx」が象徴するのは、単一の製品ではなく、企業の既存環境に溶け込むプラットフォームへの転換といえる。

IBMのアーキテクチャが日本企業と相性がよい理由は、自社環境にこだわりが強い大企業や基幹システムへの親和性にある。レガシーシステムの多さ、データ主権への慎重な姿勢、基幹システムを容易にクラウドへ移せない現実──こうした条件が、IBMのハイブリッドアーキテクチャと重なりやすい。

その実現のために大規模のM&Aを大胆に推進してきた。2019年のRed Hat買収でマルチクラウド環境でのコンテナ管理基盤OpenShiftを手に入れ、2024年のHashiCorp買収でインフラのコード化とセキュリティ統制を強化した。いずれも中間層を自前で厚くするための布石とみられる。

その中核を担うwatsonx OrchestrateはSAP、Salesforceなどのエンタープライズアプリケーションとの連携が完了している。自社モデルのGraniteをはじめ、AnthropicのClaude、GroqなどのLLMも等しく動かせるオープンな設計を採り、データからインフラ、エージェント管理、コスト管理までを共通の土台でつなぐ。この組み合わせをIBMは「ハイブリッド・バイ・デザイン」と称している。

開発層の強化として2026年に投入したのが、AIエージェント駆動の開発支援ツール「IBM Bob」だ。Anthropicとの協業で生まれたこのツールは、要件整理から仕様書生成、コード生成、テスト、コードレビューまでを一気通貫でカバーする。COBOLなどのレガシー言語にも対応しており、技術的負債とスキル継承という「2025年の崖」を意識した設計になっている。IBM社内では3万3,000人が活用し、47.5%の生産性改善を記録しているという。「SNSなどでの評判を見ると、AI開発者からの信頼が非常に厚い」と日本IBMの山口明夫社長は語る。IBMの戦略を整理すると、中間層のオーケストレーション能力を起点に、基盤層とレガシーを抱えた開発層の両方に手を伸ばす構図が浮かぶ。

Oracle──基盤とデータを一体化させた垂直統合で攻める

Oracleの競争力の源泉は「AIをアプリケーションの外に置かない」という設計思想にある。かつてリレーショナルデータベース市場を席巻した同社が、AI時代には基盤層からアプリケーション層までの垂直統合で勝負に出ている。

財務・調達・人事・サプライチェーンのデータを同一基盤に統合できる構造のため、AIが情報を取得するためにわざわざ外部システムにアクセスする手間が生じない。「AI機能は追加費用なしで提供する。AIがオプションではなく必須のアプリケーションになってくるからだ」と、日本オラクル理事の中山耕一郎氏は語る。

基盤層では2025年のOracle AI WorldでAIスーパーコンピュータ「OCI Zettascale10」と高速通信技術「Oracle Acceleron」が発表された。LLMは自社では開発せず、Claude、Gemini、Llama、OpenAIなど多様なモデルをOCI上でホスティングする方針を取り、NVIDIAに加えてAMDの最新チップにも対応する。「今世界中のAIプレイヤーがOCI上で動いている」と日本オラクルの佐藤裕之氏は話す。SaaSであるOracle Fusion Cloud ApplicationsもこのOCI上で稼働しており、基盤層とアプリケーション層が直結した構造こそが競合にはない強みとなっている。

データ層では、企業向けデータ基盤「AI Data Platform」と次世代データベース「Oracle AI Database 26ai」が中核を担う。「AI Database 26ai」は日常の取引処理とデータ分析を同一基盤で同時にこなせる設計を持ち、セキュリティのアクセス制御もアプリケーション側ではなくデータベース側で一元管理する。「今までオラクルが培ってきたテクノロジーがAIに追いついてきた」と佐藤氏は表現する。

開発層では「Oracle AI Agent Studio」がFusion Cloud Applicationsに組み込まれており、自社開発部門が使うエージェント開発環境をそのままユーザー企業やパートナーに開放している。資格者はすでに3万人を超え、パートナー提供のエージェントがマーケットプレイスに100本以上並ぶなど、エコシステムの立ち上がりは早い。Oracleの勝ち筋は、データ層の一体性を崩さないまま基盤層と開発層に力を注ぐ垂直統合にある。